预训练和元训练:授模型以鱼和授模型以渔

训练最初以教会模型完成多种多样的任务为出发点。在大规模预训练中,模型除了记住训练任务本身之外,涌现出的最重要的能力就是上下文学习(In-Context Learning)。这种能力帮助大模型通过提示信息构建完成新任务的能力。

OmniRL提出了一种大规模元训练方法。与预训练不同,OmniRL的目标并非记忆具体任务的技能,而是学习“如何进行强化学习”这一过程本身。元学习(Meta-Learning),即“学习如何学习”(Learning To Learn),早在80年代就被提出。但OmniRL论文指出,缺乏大规模任务和长序列支撑的元学习,容易陷入“任务识别”模式:模型只是记住了训练环境,在推理时通过识别当前处于哪个环境来“激活”对应的技能。这种模式不具备对未见任务和分布外任务的泛化能力。

随机世界:AnyMDP

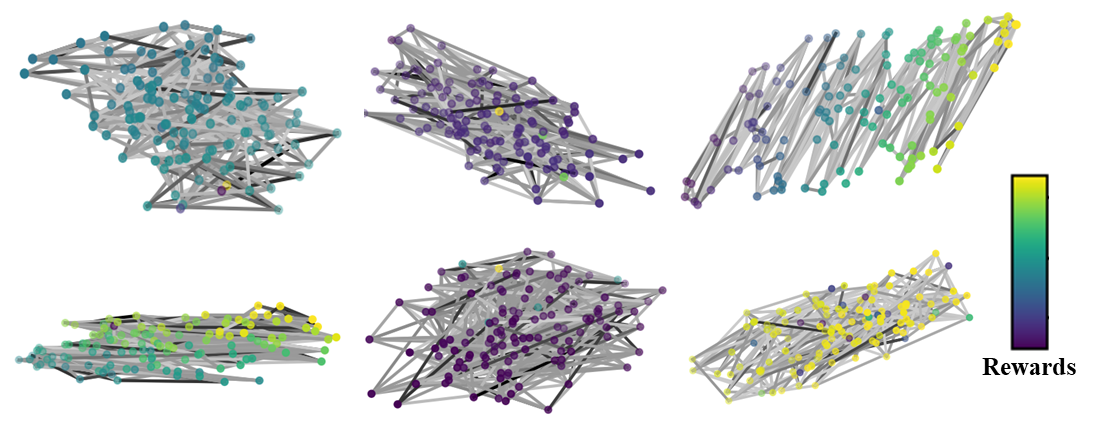

AnyMDP生成的随机世界示例。点的颜色标识状态的平均奖励,线的深度标识状态之间的平均转移概率。

AnyMDP生成的随机世界示例。点的颜色标识状态的平均奖励,线的深度标识状态之间的平均转移概率。

AnyMDP基于马尔可夫决策过程(Markov Decision Process, MDP)构建随机迁移概率和奖励函数,能够快速、低成本地生成海量、可规模化的环境用于元强化学习。我们生成了超过50万个不同的任务,并基于这些任务合成了超过100亿时间步的数据用于元训练,单个序列的时间步长最长超过100万。

首次利用上下文学习统一多强化学习和模仿学习

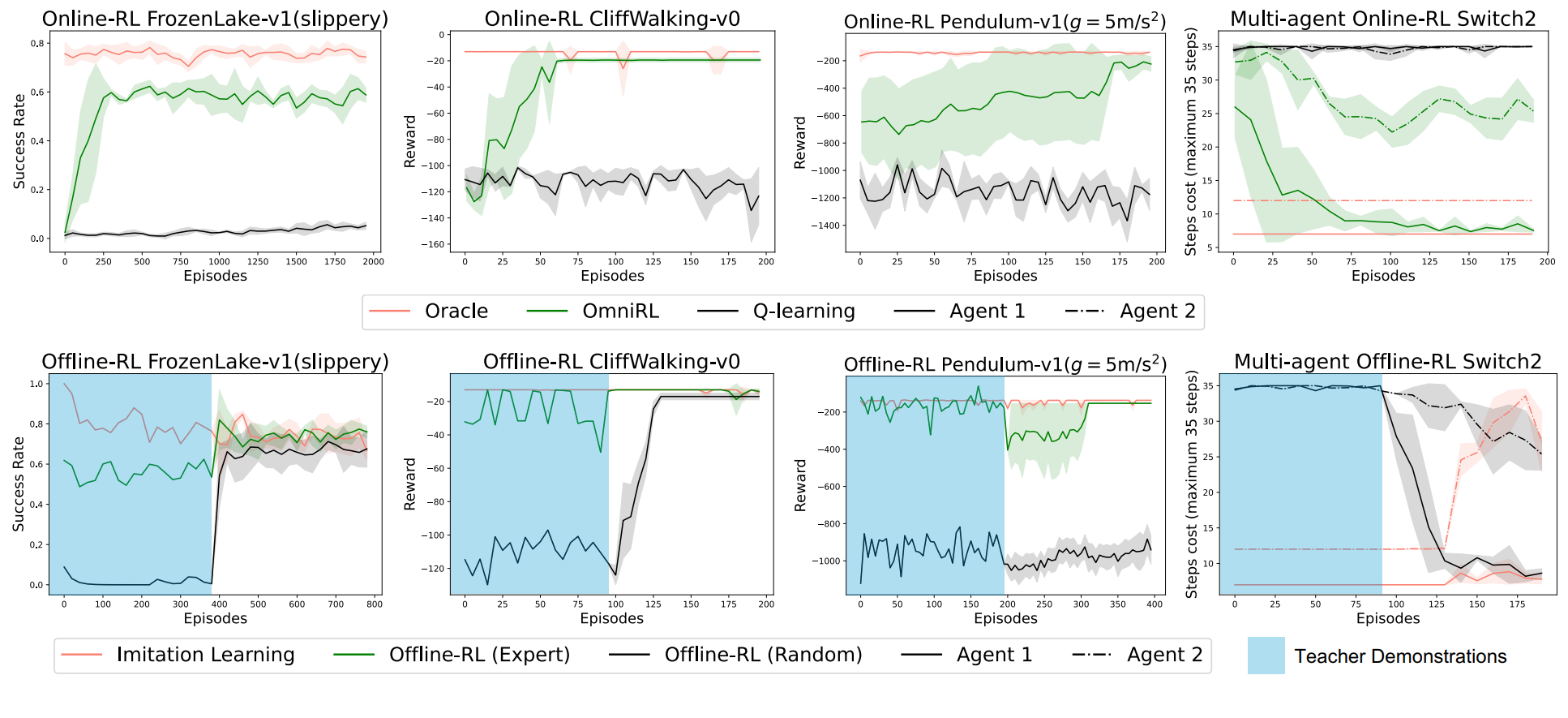

OmniRL提出同时利用先验信息和后验奖励(Feedback)进行上下文学习,使模型能够根据需求在不同学习模式间自主切换。下图展示了在随机世界中训练的OmniRL模型,仅通过上下文学习(不依赖任何梯度优化),在冷启动或预先给定一段演示轨迹(包括专家演示和较差演示)的情况下,能够通过在线强化学习(Online-RL)、离线强化学习(Offline-RL)和模仿学习(IL)的自主切换,达到较好表现,证明了上下文学习具有巨大的灵活性。此外,模型还能够在演示基础上,通过自主探索持续提升自身能力。

OmniRL在完全未见过的Gymnasium环境中的表现

OmniRL在完全未见过的Gymnasium环境中的表现

OmniRL训练的智能体甚至可以完成多智能体协作任务。通过将对方的状态引入观测空间,模型能够完成如Switch这类简单任务,这类任务要求智能体展现不同的行为模式以实现协作。通过模型的上下文学习和适应能力,两个由OmniRL控制的智能体能够有效完成上述协作任务。

首次揭示数据多样性与序列长度的重要性根源

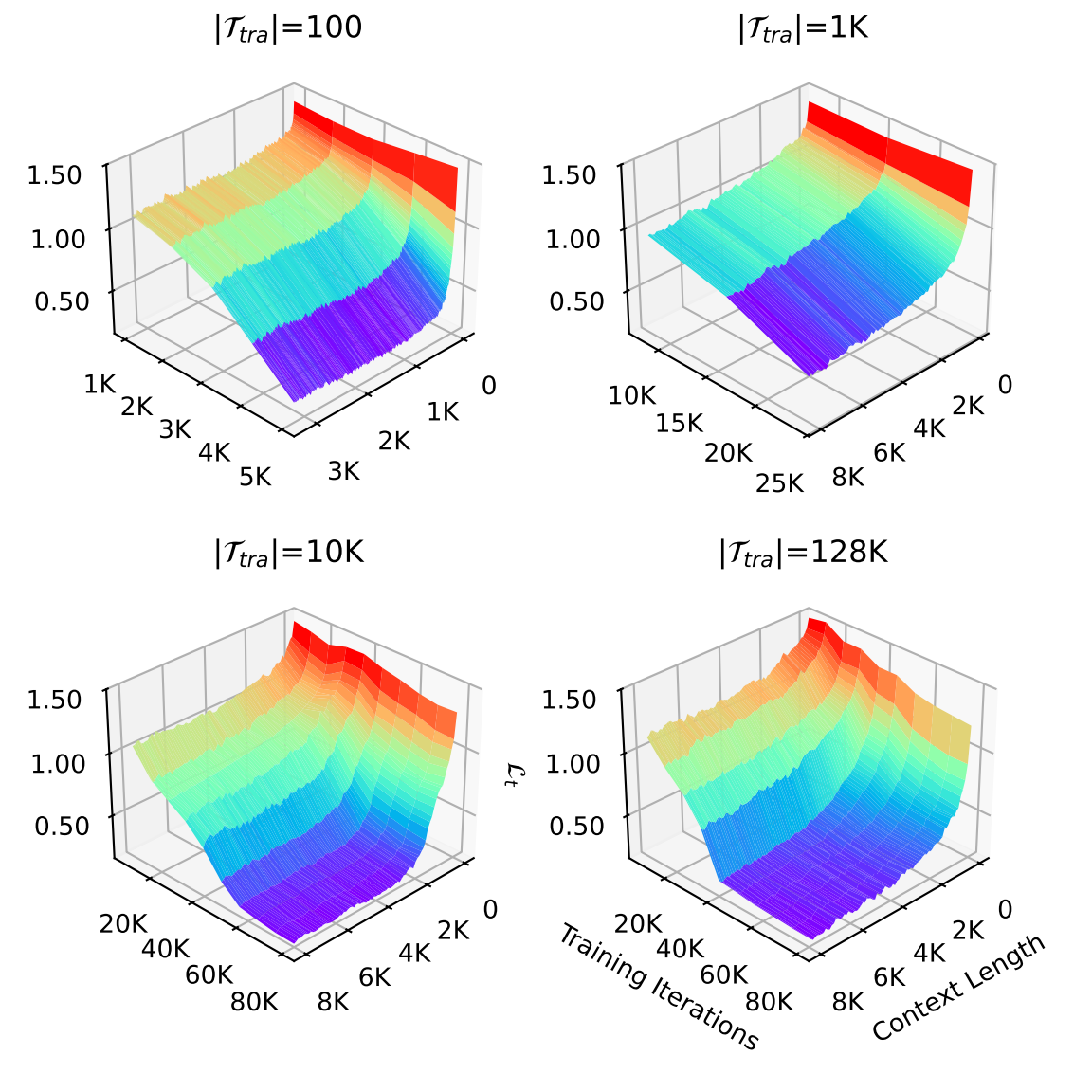

模型的位置损失与元训练步数及上下文长度的关系

模型的位置损失与元训练步数及上下文长度的关系

OmniRL使用数千万参数的Transformer和高效线性注意力结构进行建模,训练任务数超过50万个,时间步数超过100万。实验对比了相同数据量但来自不同任务数量的效果,发现当任务数量不足时,模型会转向“记忆 + 环境识别”模式,即将所有训练环境储存在参数记忆中,通过上下文快速辨识。这种模式下,智能体能够以更少的样本适应训练过程中见过的环境,但却无法泛化到未见环境。而当任务数量足够充分时,才能激发真正的通用上下文学习能力,这种能力可以有效泛化到未见任务,但对于所有任务都需要更长的上下文学习周期。

这一结论在一定程度上表明:

- 数据的完整性和多样性比数据的绝对准确性(absolute fidelity)更为重要。 即使采用失真的数据,通过提升上下文学习的泛化性,也有可能更好地泛化到真实任务。

- 长序列建模和长时记忆是通用学习能力的自然选择。 当训练任务数量增加时,模型在学习过程中会自然选择不去记忆任务关联的知识,而是只记忆学习方法,从而导致对训练集中出现的任务也需要更长的适应时间——这正是大规模元学习的特点。

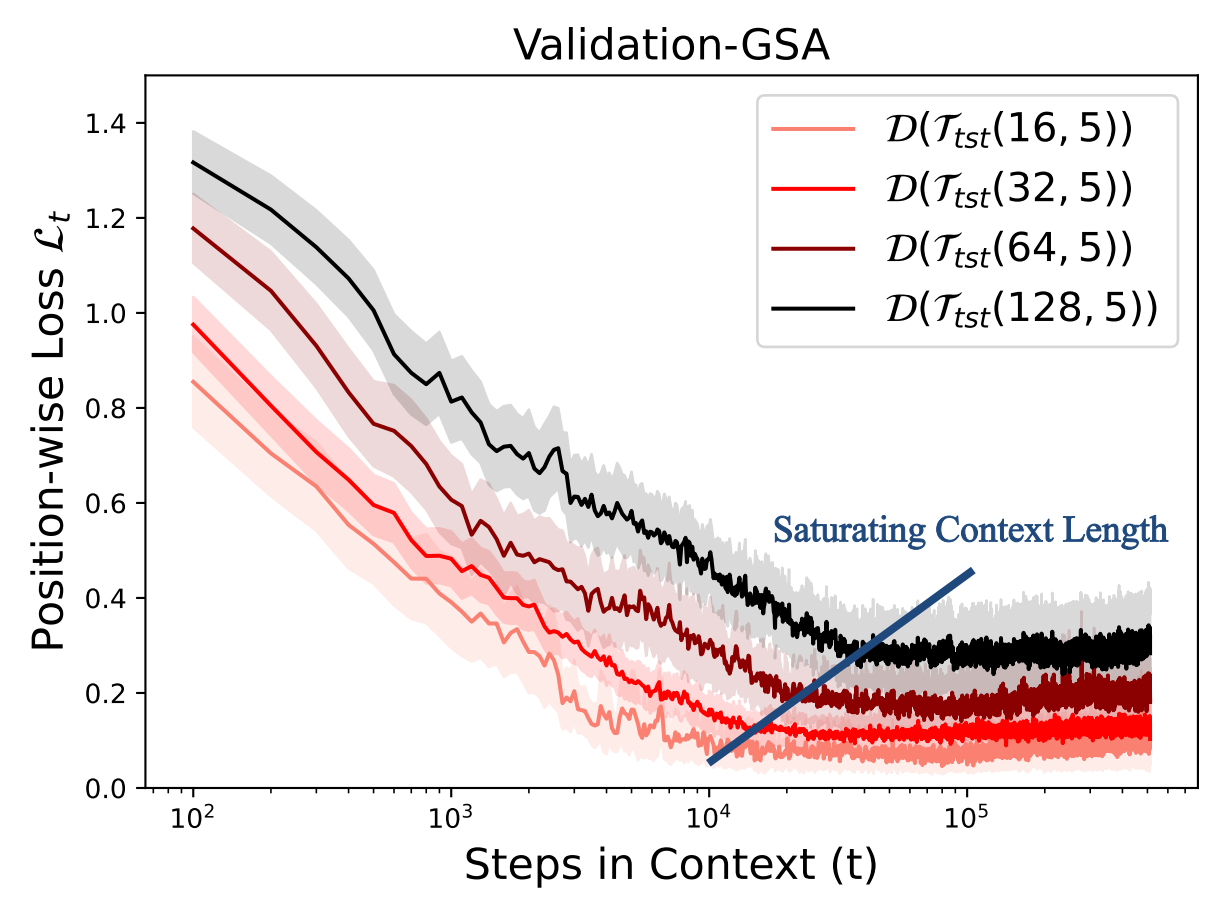

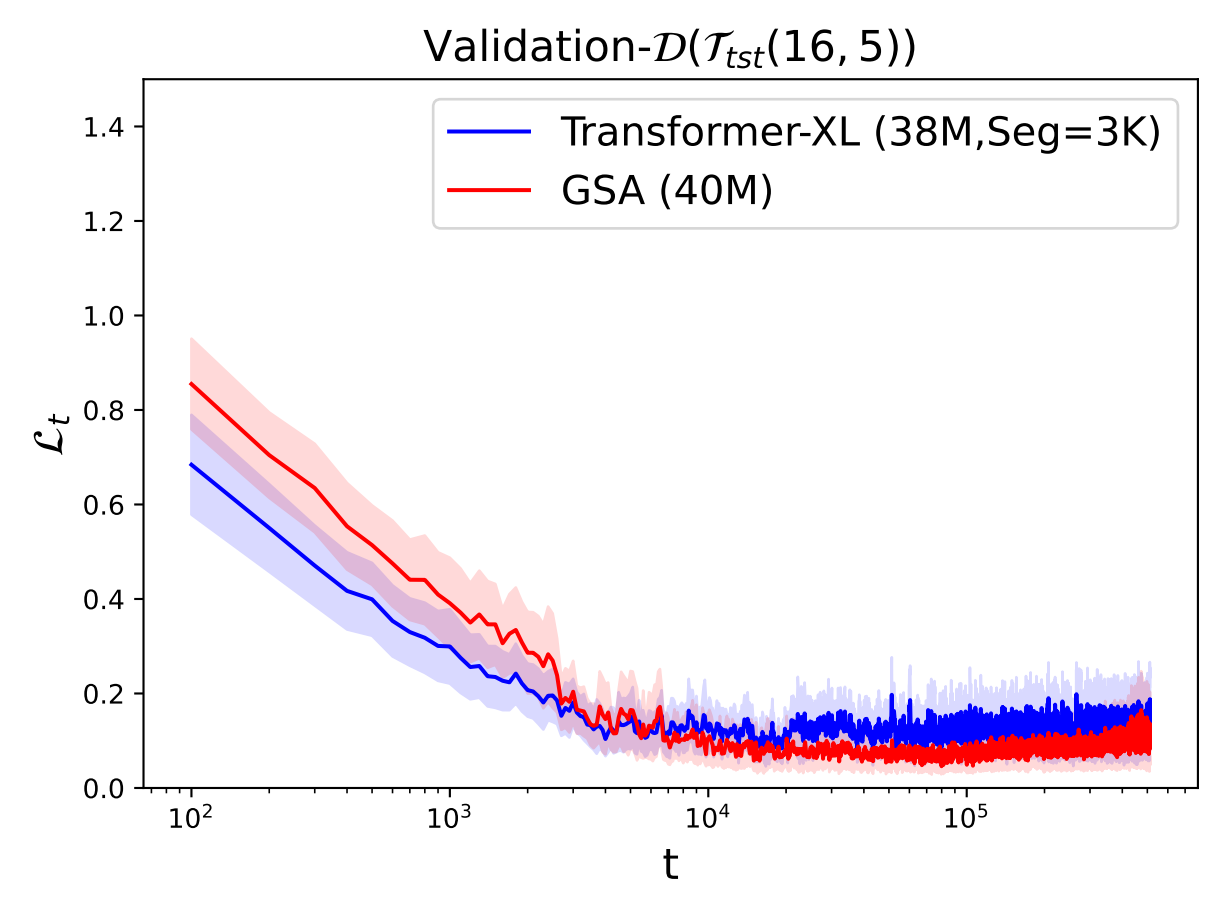

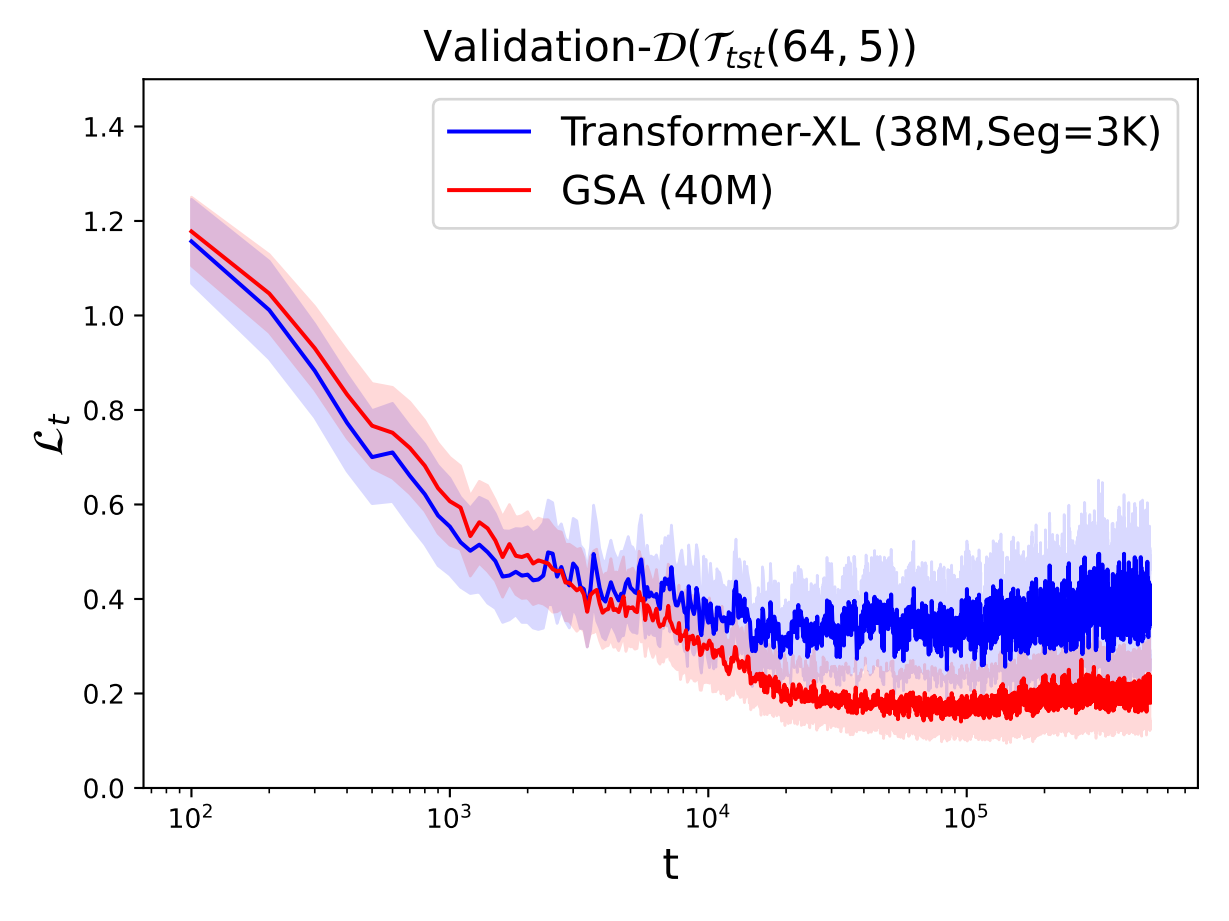

线性自注意力机制在效率和长序列表现上的明显优势

模型的位置损失与元训练步数及上下文长度的关系

模型的位置损失与元训练步数及上下文长度的关系

OmniRL首次展示了线性注意力机制的优势。随着问题规模增加,上下文长度需要同步增长,Transformer的效率瓶颈愈发明显。相比之下,线性注意力机制在效率和长序列建模上都具有明显优势;相对于滑窗注意力机制,在长时序段也表现出显著的效果优势,这证明AnyMDP提供了一个极佳的长序列评测环境。

面向下一代通用具身智能体的技术探索

我们的最终目标是实现对任意环境都能完全自主探索和学习的智能体,这对具身智能的意义尤为重大。大语言模型通过参数记忆捕捉了大量常识、百科知识和数理逻辑,构成了其零样本能力的基础。但具身智能面对多样化的环境、任务以及复杂的本体异构性,常识很难成为解决问题的核心。我们认为,自主学习能力和长时记忆将是通用具身智能体的关键。

与当前大语言模型的长时序推理和思维链的异同

当前OmniRL更侧重于系统1(直觉思维)的学习能力,而大语言模型的长时序推理和思维链更侧重于系统2(逻辑思维和规划)本身。无论是系统1还是系统2能力的学习与提升,当前主流大模型都尚未充分探索,OmniRL在这一方面填补了诸多空白。